vSphere 9 では、新機能として Memory Tiering(メモリ階層化) が提供されました。

Memory Tiering を利用することで、DRAM に加えて NVMe デバイスをメモリとして利用し、メモリ容量を拡張することが可能になります。機能については別の記事で紹介していますので以下をご確認ください。

NVMeでメモリ容量を拡張? vSphere 9 の新機能「Memory Tiering」を解説

本記事では、Memory Tiering を有効化する手順を紹介します。

※以下の内容をもとに紹介します。

https://techdocs.broadcom.com/us/en/vmware-cis/vsphere/vsphere/9-0/vsphere-resource-management/memory-tiering-over-nvme/memory-tiering-configuration.html

Memory Tiering とは

別記事の紹介をしましたが、この記事でも簡単に機能概要をご紹介します。

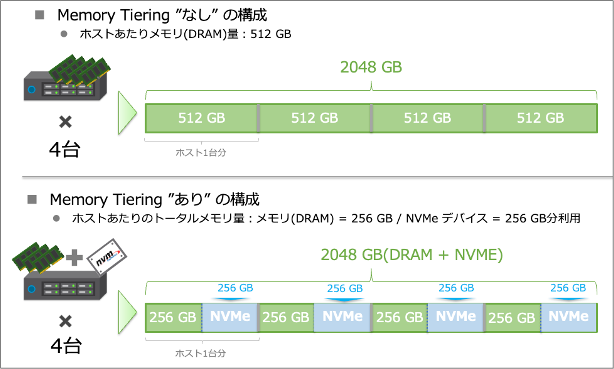

Memory Tiering は、DRAM と NVMe を組み合わせてメモリとして利用する機能です。ESX ホストで Memory Tiering を有効化すると、「DRAM + NVMe = 拡張メモリ」として扱われ、実効的なメモリ容量を拡張できます。

これにより、少ない DRAM 構成でも NVMe を活用してメモリ容量を補完でき、実質的に約 2 倍のメモリ容量を利用することが可能になります。

イメージ図

VM からは 単一のメモリとして認識され、VM の設定変更なしで利用できます。

また、アクセス頻度の高いデータは DRAM、低いデータは NVMe に自動配置されます。

検証環境

検証環境の情報は以下の通りです。

【vSphere クラスタ】

| 項目 | 構成 |

| vCenter | 9.0.2 |

| ESX | 9.0.2 |

| ホスト数 | 3 |

| CPU | 16 Core |

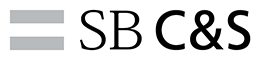

| メモリ | 64 GB |

| ストレージ(ローカル) | 256 GB |

| Memory Tiering 用 NVMe ストレージ | 128 GB |

この時点で vSphere Client 上では、ESX ホストのメモリ容量は DRAM として 「64 GB」 と認識されています。

※本環境は Nested 環境のためパフォーマンス検証は実施していません。

それでは、Memory Tiering を有効化するために以下の手順を実施していきます。

事前準備

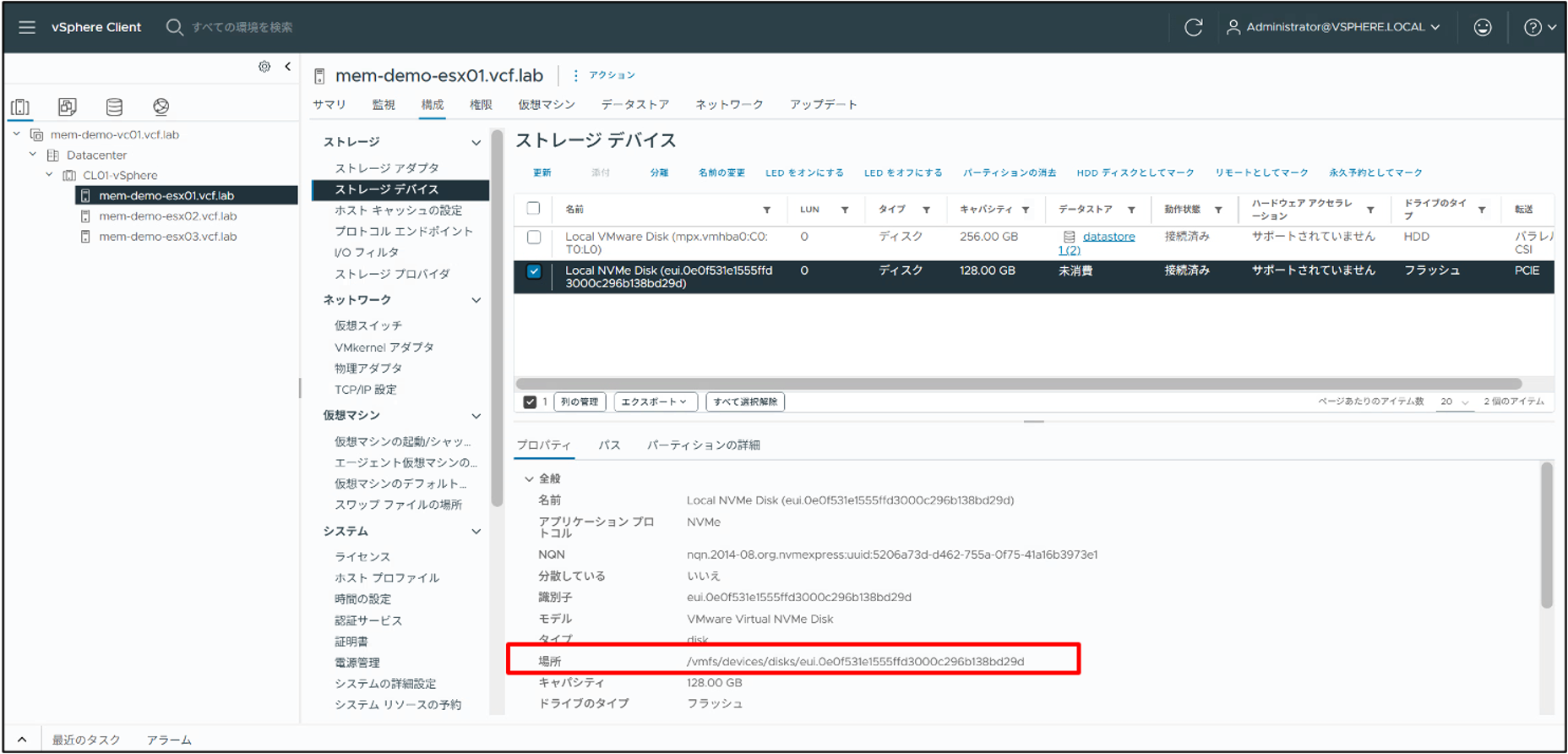

NVMe デバイスの確認

各 ESX ホストに Memory Tiering 用 NVMe デバイスが認識されていることを確認します。有効化する際に「場所」の情報が必要となるためこちらも確認します。

※ストレージデバイスのベンダーによって「場所」に記載される名前の形式は異なります。

NVMe デバイスに階層化パーティションを作成

各ESXのコンソールかSSHでアクセスして以下のコマンドを実行します。

メンテナンスモードへの移行

vSphere Client のGUIからでも実行可能ですが、本検証ではコマンドで実行しました。

esxcli system maintenanceMode set -e true階層化パーティションの作成

前述の「NVMe デバイスの確認」で確認した「場所」を入力します。※オレンジの文字が「場所」です。

esxcli system tierdevice create -d /vmfs/devices/disks/eui.Oe0f531e1555ffd3000c296b138bd29d

パーティション確認

パーティションが作成されているか確認します。

esxcli system tierdevice list/*実行結果イメージ↓

DeviceName PartitionId StartSector EndSector

-------------------------------------------------------- -------------- --------------- --------------

eui. Oe0f531e1555ffd3000c296b138bd29d 1 2048 268435422

vSphere Configuration Profiles の有効化

本検証では、クラスタ レベルで Memory Tiering を有効化するため vSphere Configuration Profiles(クラスタレベルでの構成の管理)を有効にします。

vSphere Configuration Profiles を使用して Memory Tiering の有効化や動作ポリシーを制御します。ここでは、vSphere Configuration Profiles を使用して Memory Tiering を設定する手順を説明します。

vSphere Client からクラスタの 「構成」-「目的の状態」-「構成の作成」をクリックします。

クラスタ内の既存ホストから基準となる状態を抽出するため、「リファレンス ホストからのインポート」を実施し「次へ」をクリックします。

事前チェックで問題がないことを確認し「完了して適用」をクリックします。

Memory Tiering 有効化

ドラフトの作成と変更の適用

vSphere Configuration Profiles の vmkernel のオプション設定を通じて Memory Tiering の有効化や動作ポリシーを制御します。

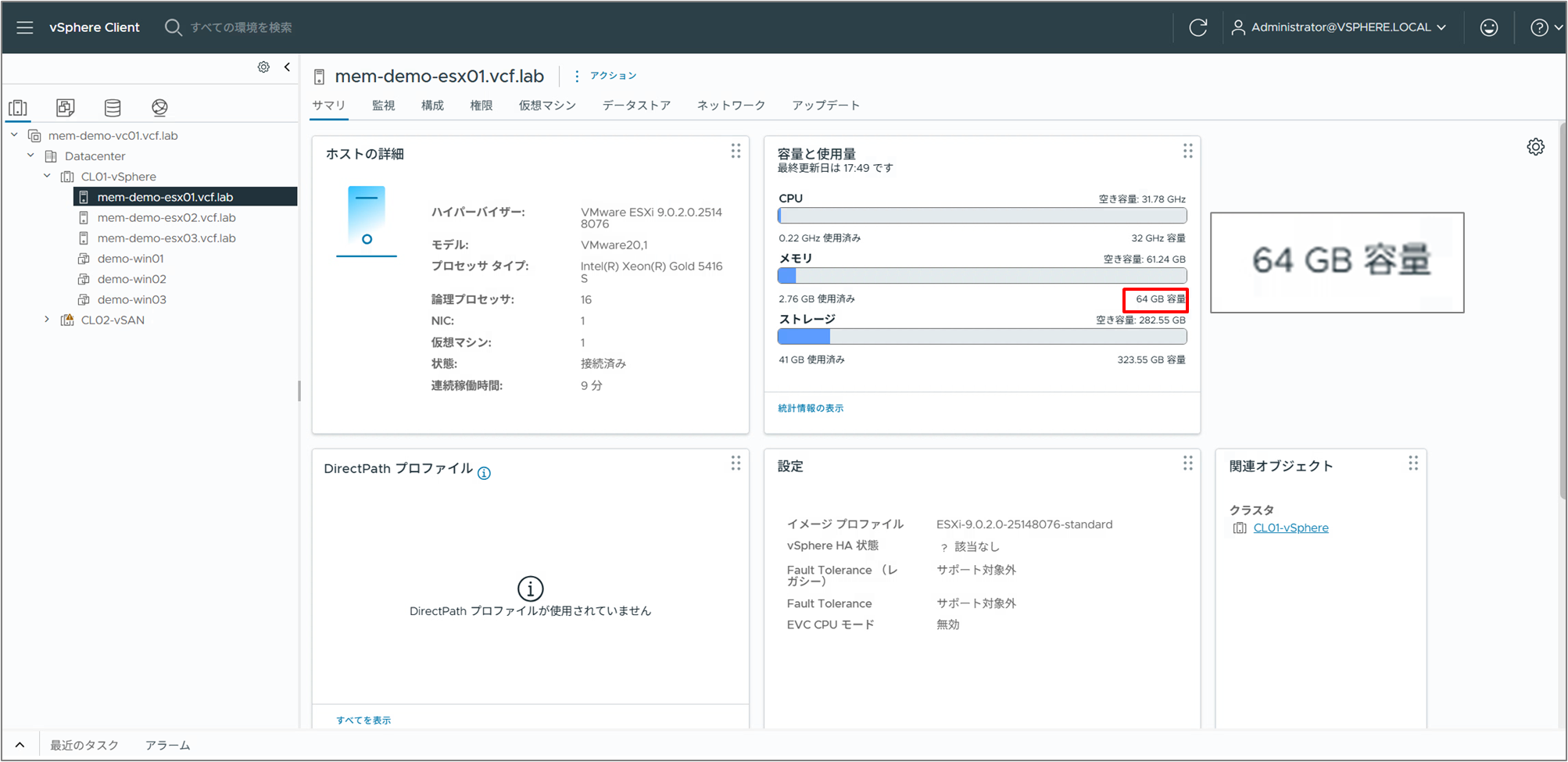

ドラフトを表示し「ドラフトの作成」をクリックします。

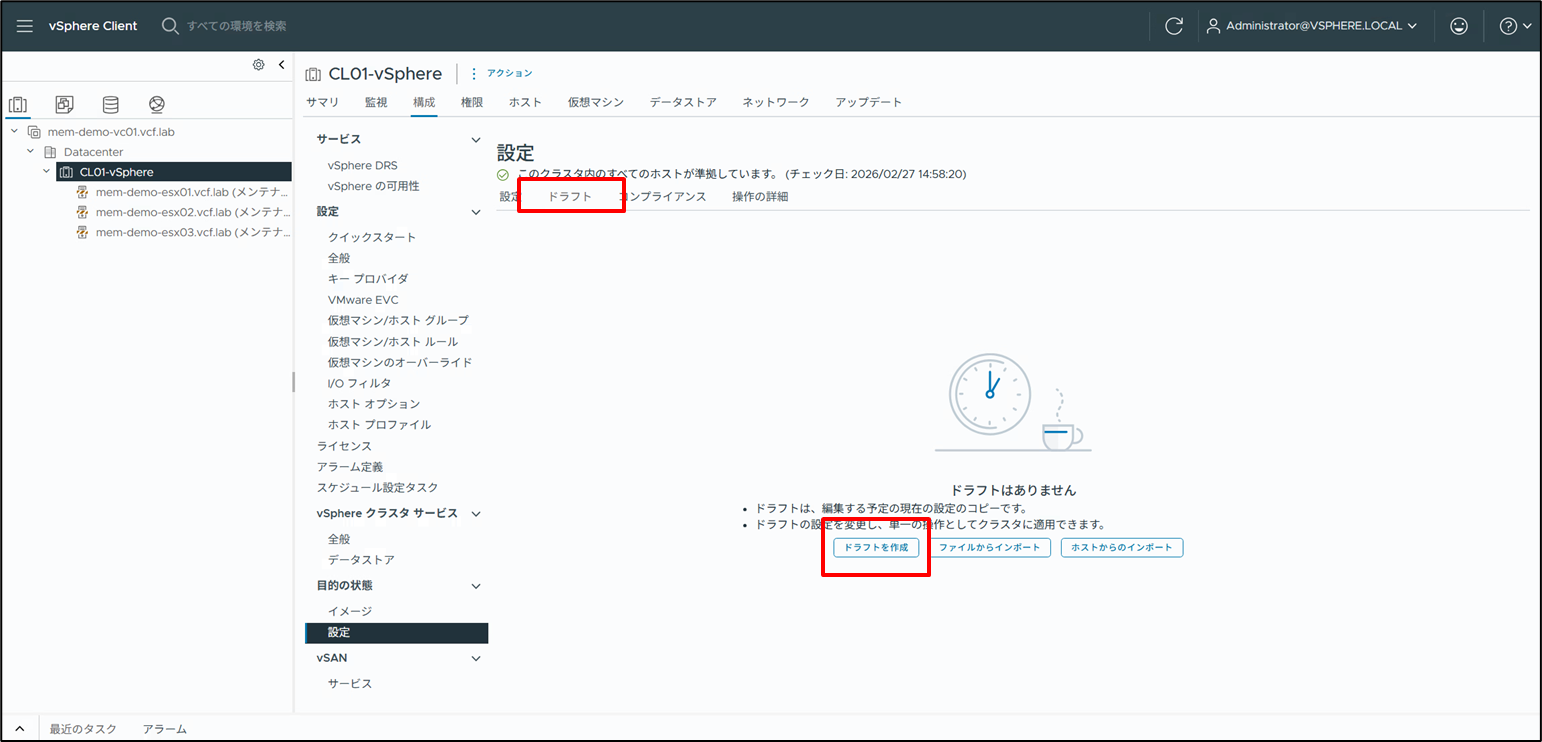

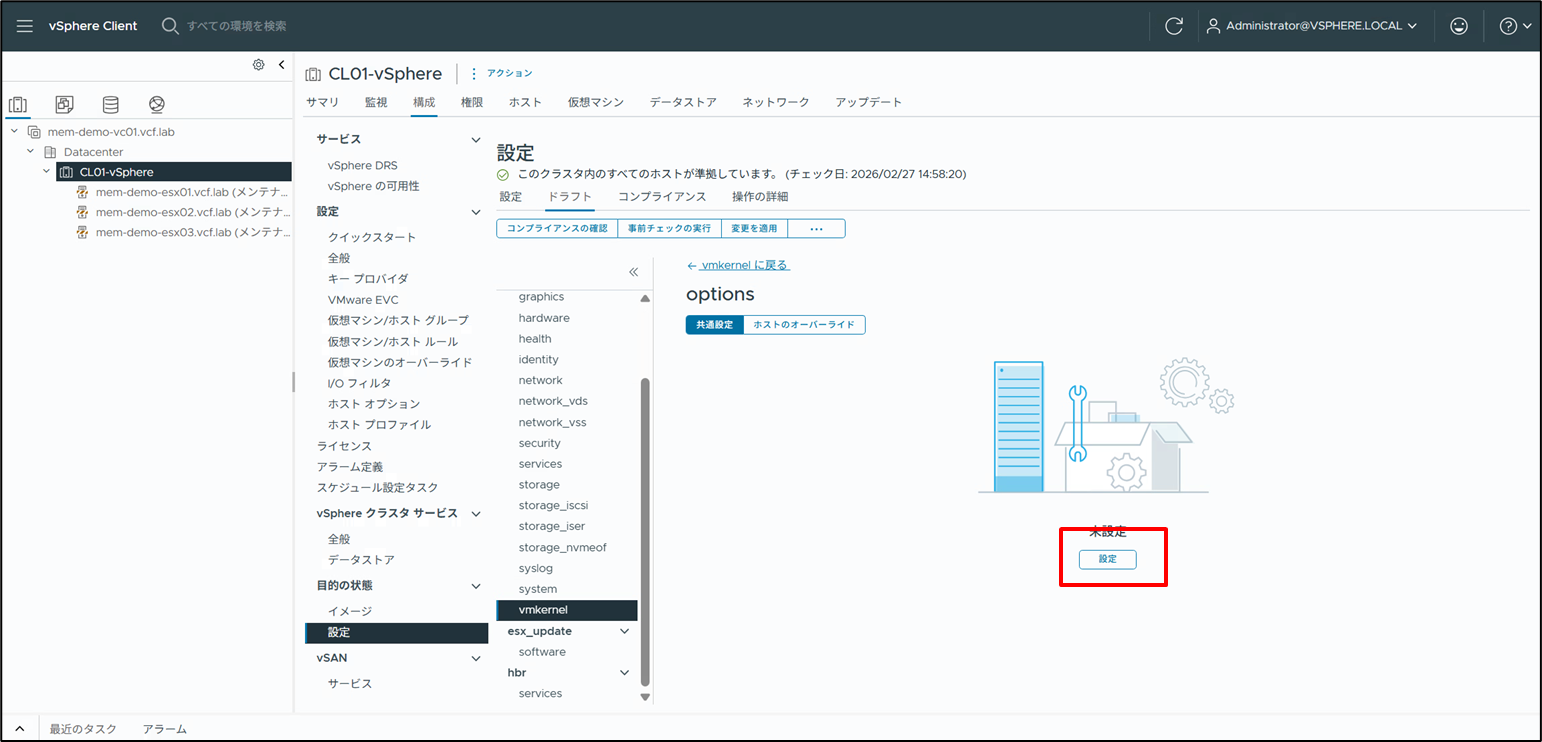

「vmkernel」で「options」をクリックします。

「設定」をクリックします。

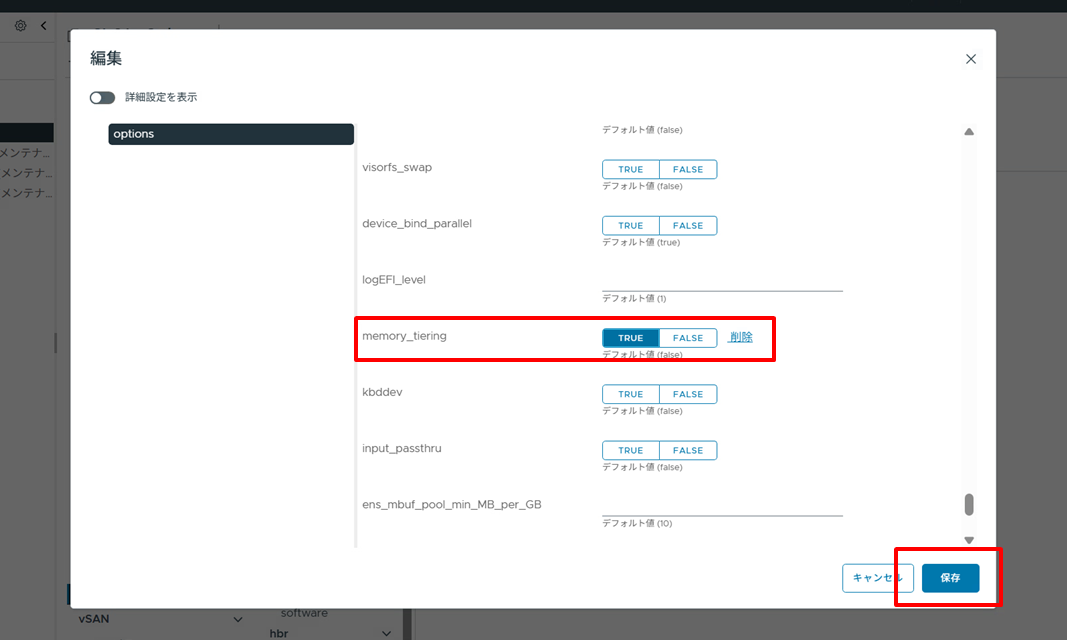

memory_tiering をの項目で「TRUE」をクリックし「保存」します。

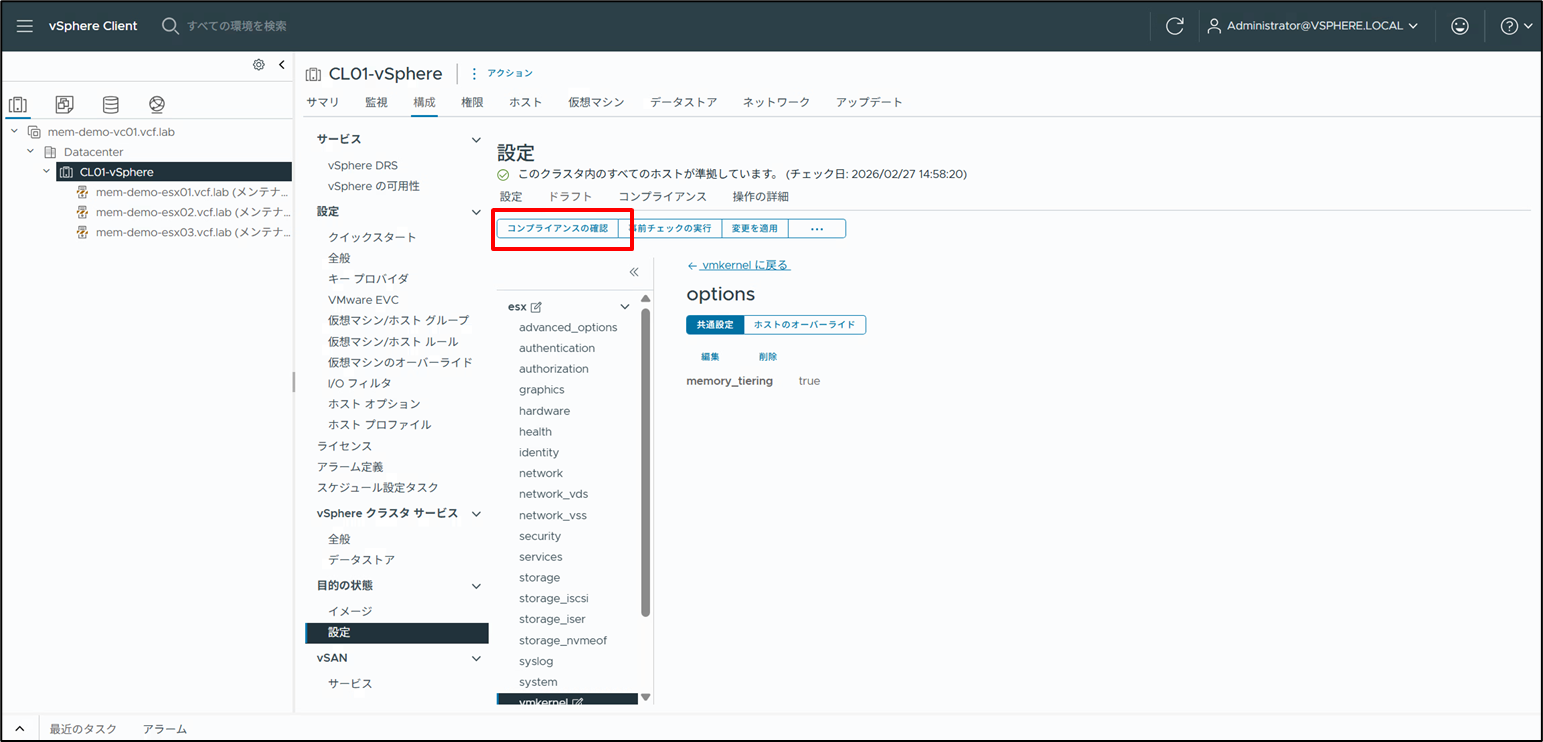

作成したドラフトで「コンプライアンスの確認」を行います。

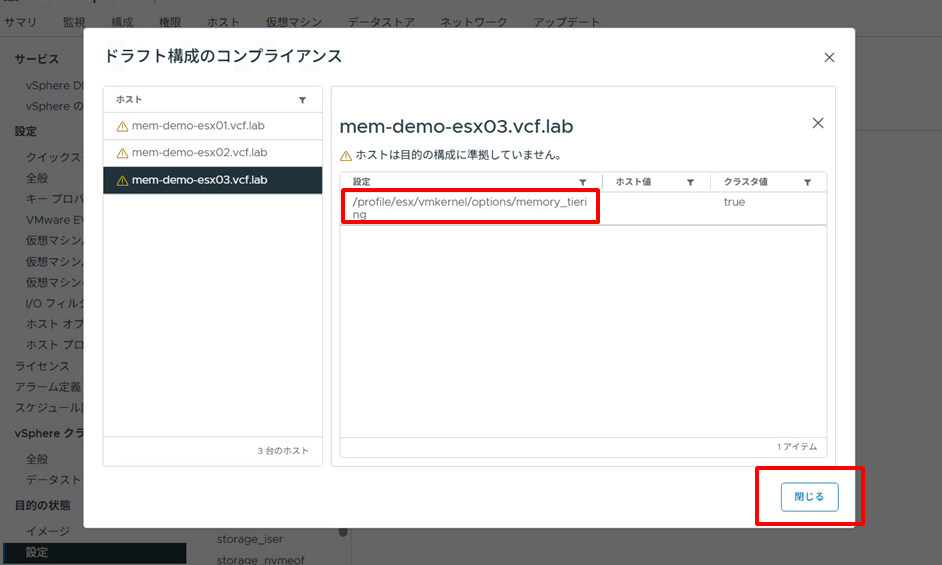

コンプライアンス違反として memory_tiering の設定差異が報告されることを確認します。

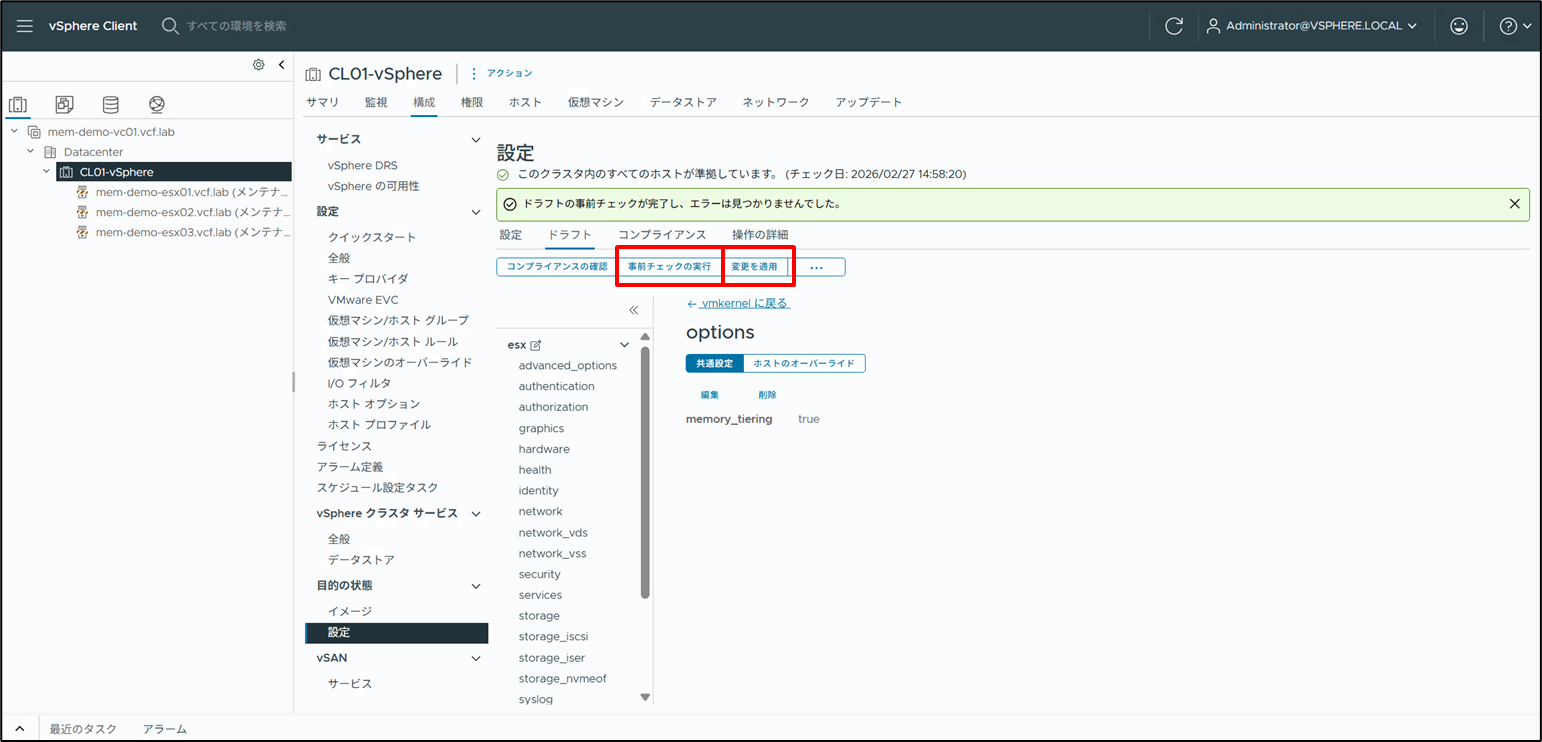

「事前チェックの実行」を行い、エラーが起きないことを確認します。「変更の適用」をクリックします。

事前チェックは実施済みなため、「次へ」をクリックします。

「次へ」をクリックします。

影響を確認して「修正」をクリックします。※ホストの再起動が発生します。

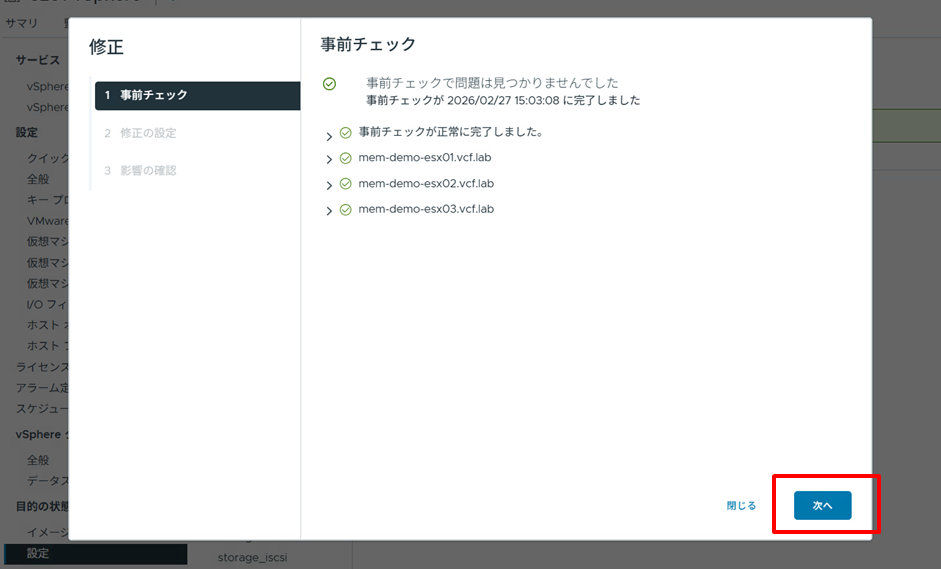

1台ずつ修正の処理が開始されます。処理が終わると完了のメッセージが表示されます。

事後作業

Memory Tiering の有効化を確認

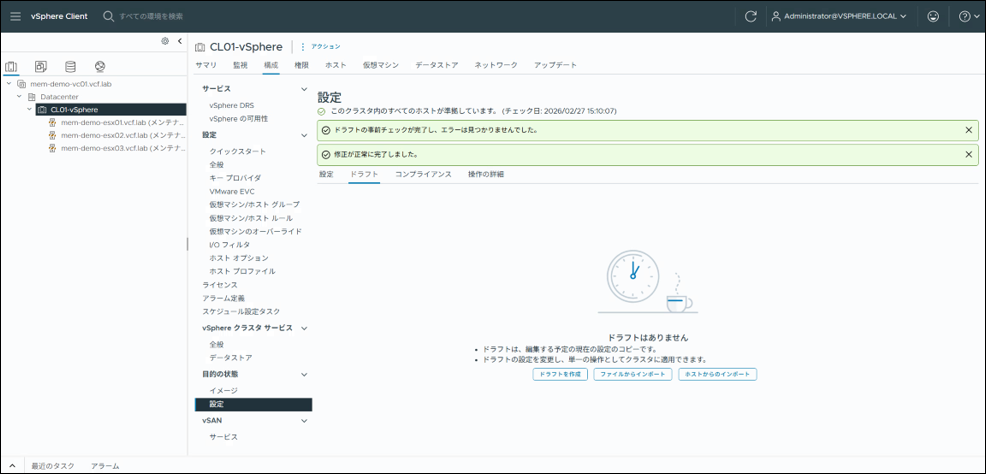

左ペインから対象クラスタを選択し、ホストの一覧を表示します。画面左下の「列の管理」をクリックし、「メモリ階層化」にチェックを入れることで、該当の列が追加され、状態を確認できるようになります。

「ソフトウェア」と表記されていれば有効になっています。

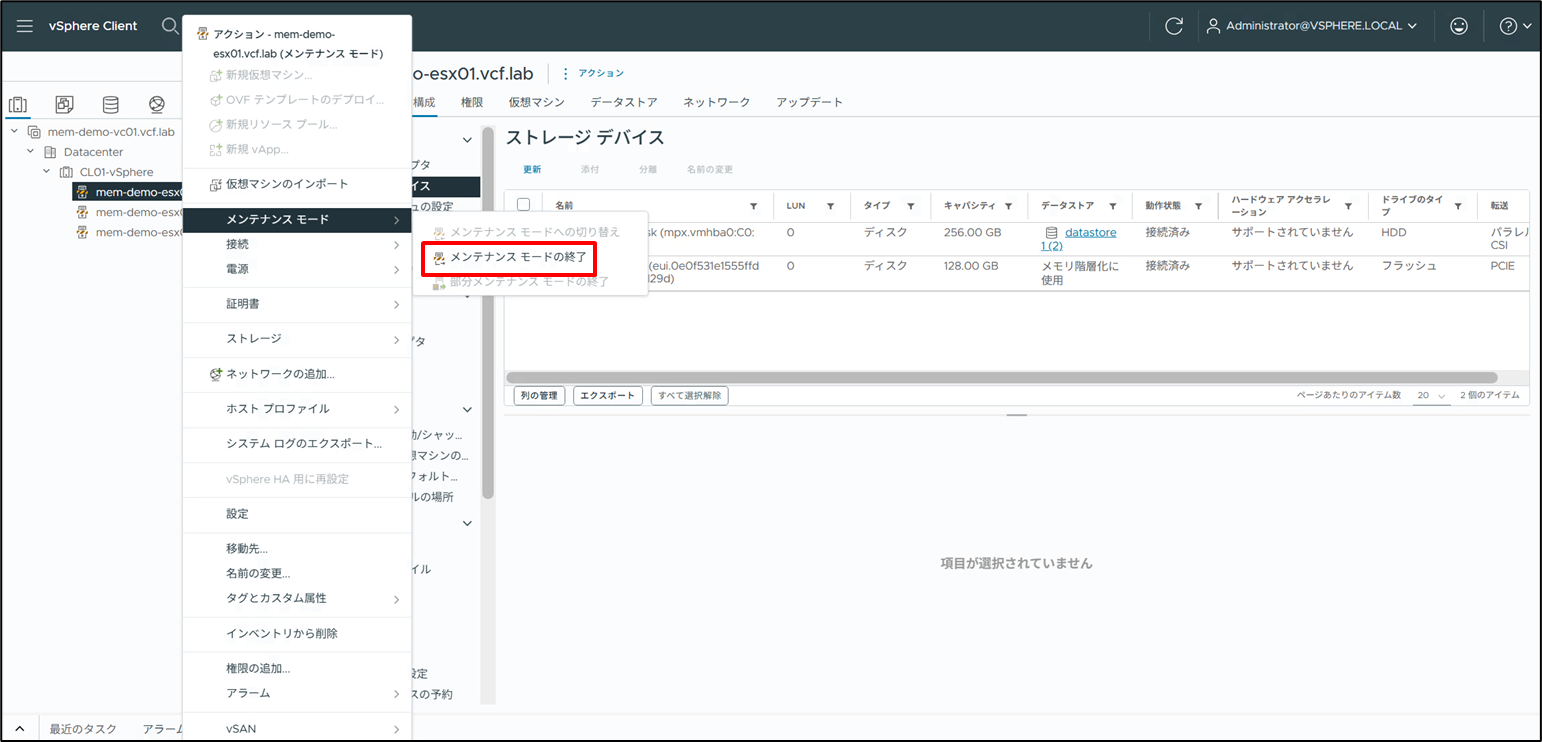

メンテナンスモードの終了

各ホストのメンテナンスモードを終了します。

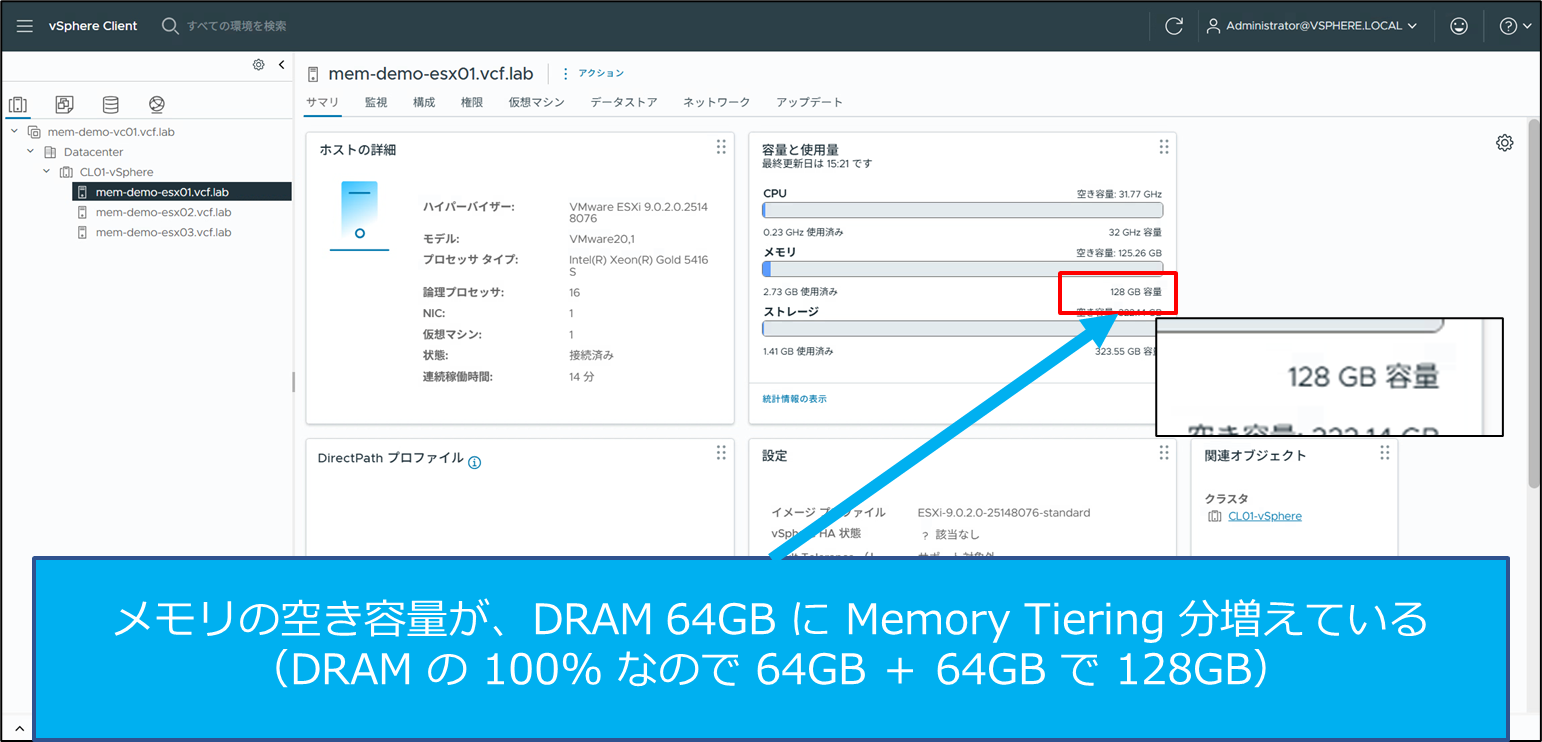

メモリサイズを確認

DRAM 64GB に対し、Memory Tiering により同容量の 64GB が追加されています。

デフォルト設定では、DRAM 容量の 100% が Memory Tiering 領域として割り当てられるため、DRAM 64GB に対して NVMe 64GB が追加され、合計 128GB のメモリとして利用されます。

Memory Tiering を有効にしてメモリ容量が増量したことを確認できました。

Memory Tiering サイズの変更

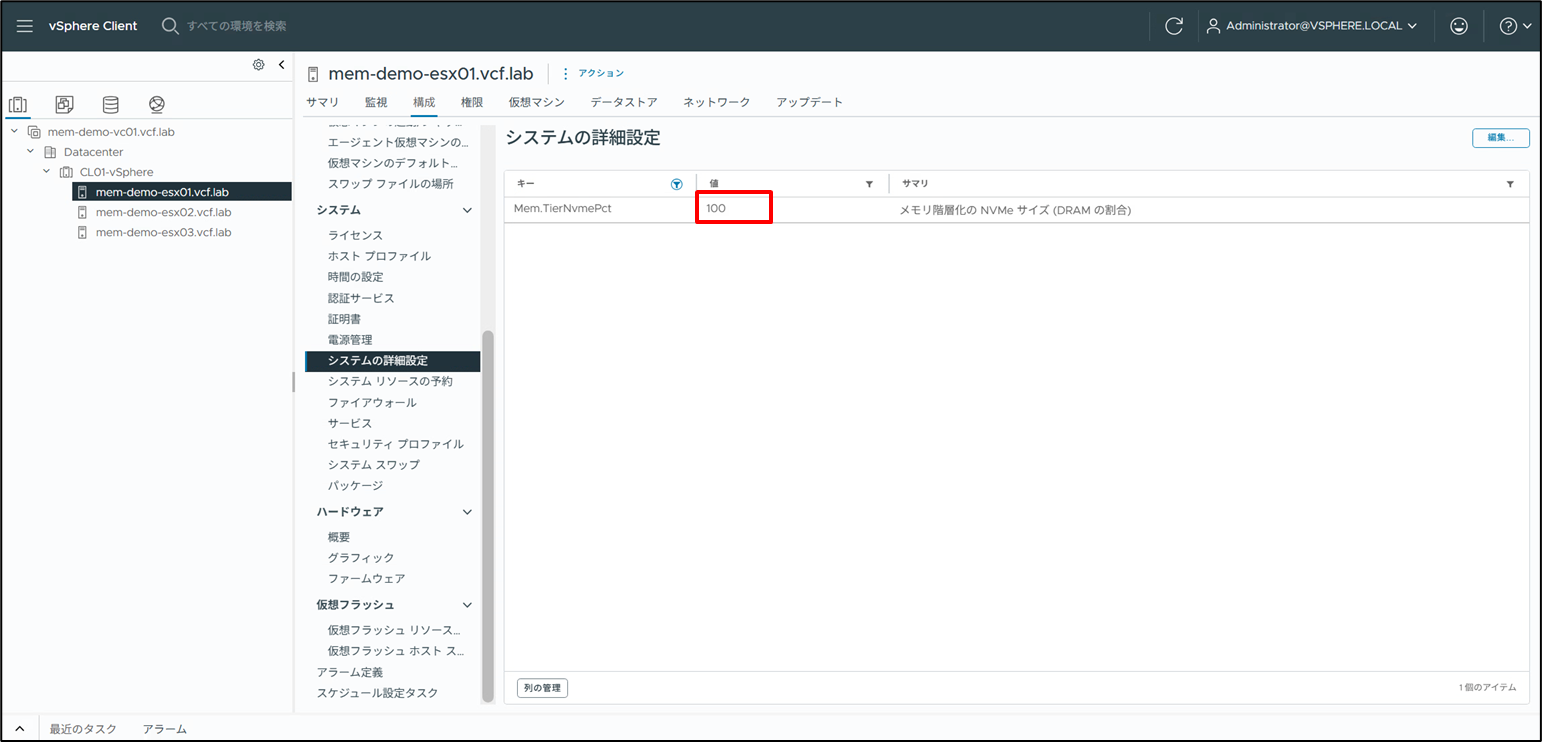

Memory Tiering のサイズはデフォルトでは DRAM と同じ100%に設定されていますが、ワークロードや要件に応じてこの割合を柔軟に変更(最大400%まで)することが可能です。

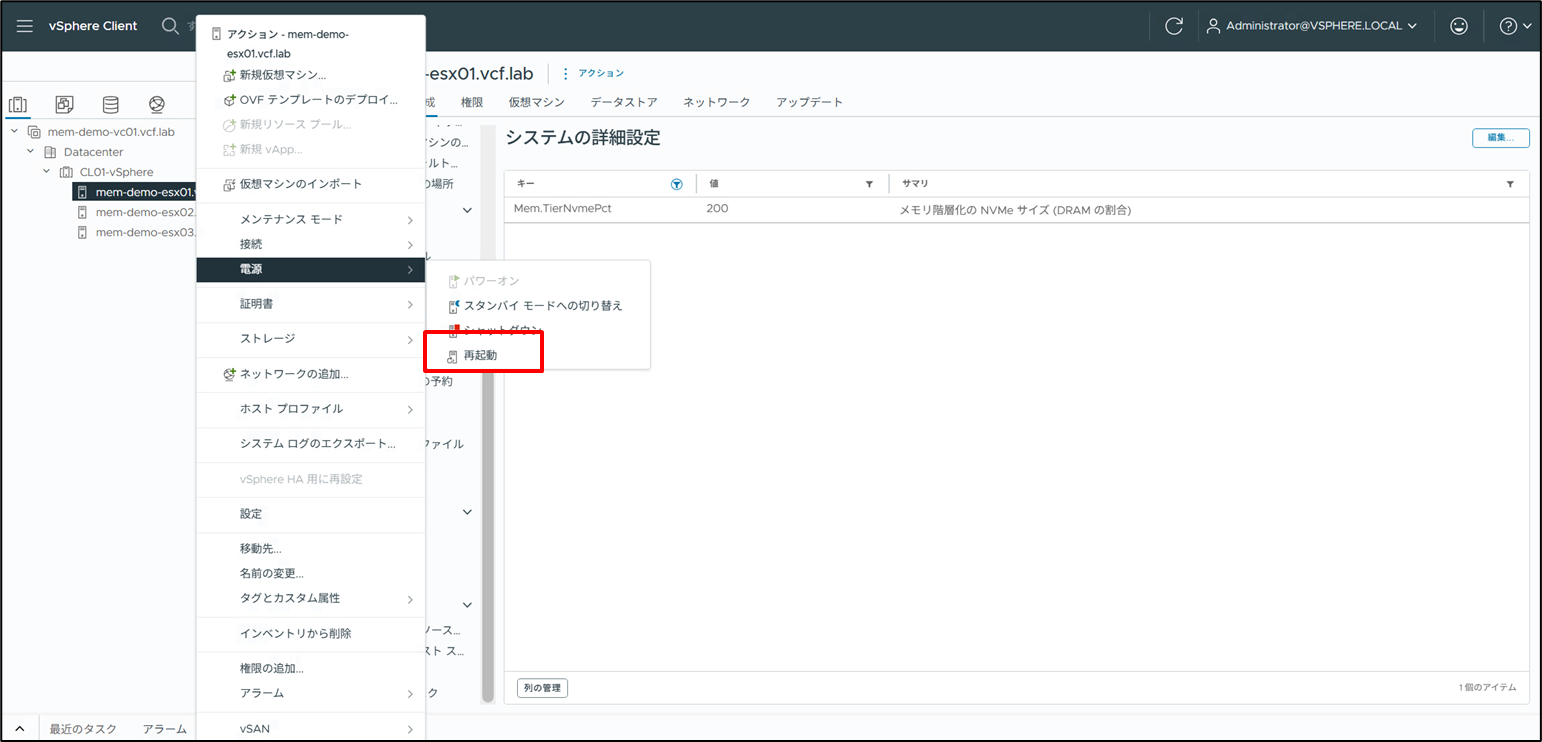

各ESXホストの「構成」の「システムの詳細設定」から「Mem.TierNvmePct」の値を変更します。

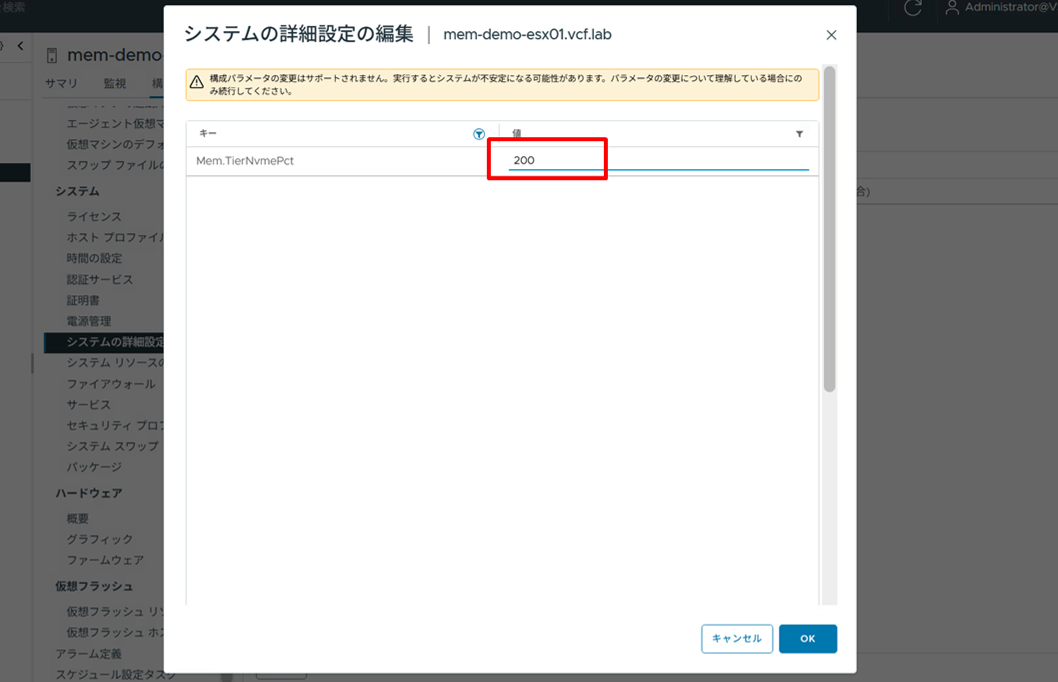

「Mem.TierNvmePct」を「200」に変更します。これにより、DRAM 64GB の 200%(128GB) が Memory Tiering で利用可能となります。

設定変更後はホストを再起動して反映させます。

ホストを確認すると、メモリ容量が増えています。メモリの容量は、DRAM 64GBに対してMemory Tiering分が加算され、設定が200%の場合は64GB+128GBとなり、合計192GBとして利用可能となります。

参考①:ホストレベルでMemory Tiering を有効化する手順

ここまでクラスタに対する手順を紹介してきましたが、Memory Tiering をホストレベルで有効にする方法もあるため、あわせて紹介します。

ホストレベルで有効化する主なケースとしては、ワークロードの高い VM を稼働させるホストでは Memory Tiering を使用せず、特定のホストのみに適用したい場合などが挙げられます。

例えば、低レイテンシが求められるワークロードでは DRAM のみで運用したいケースや、検証用途のホストのみに段階的に適用したいケースなどが考えられます。そのため、クラスタレベルではなくホストレベルで制御することで、ワークロードに応じた柔軟な運用が可能になります。

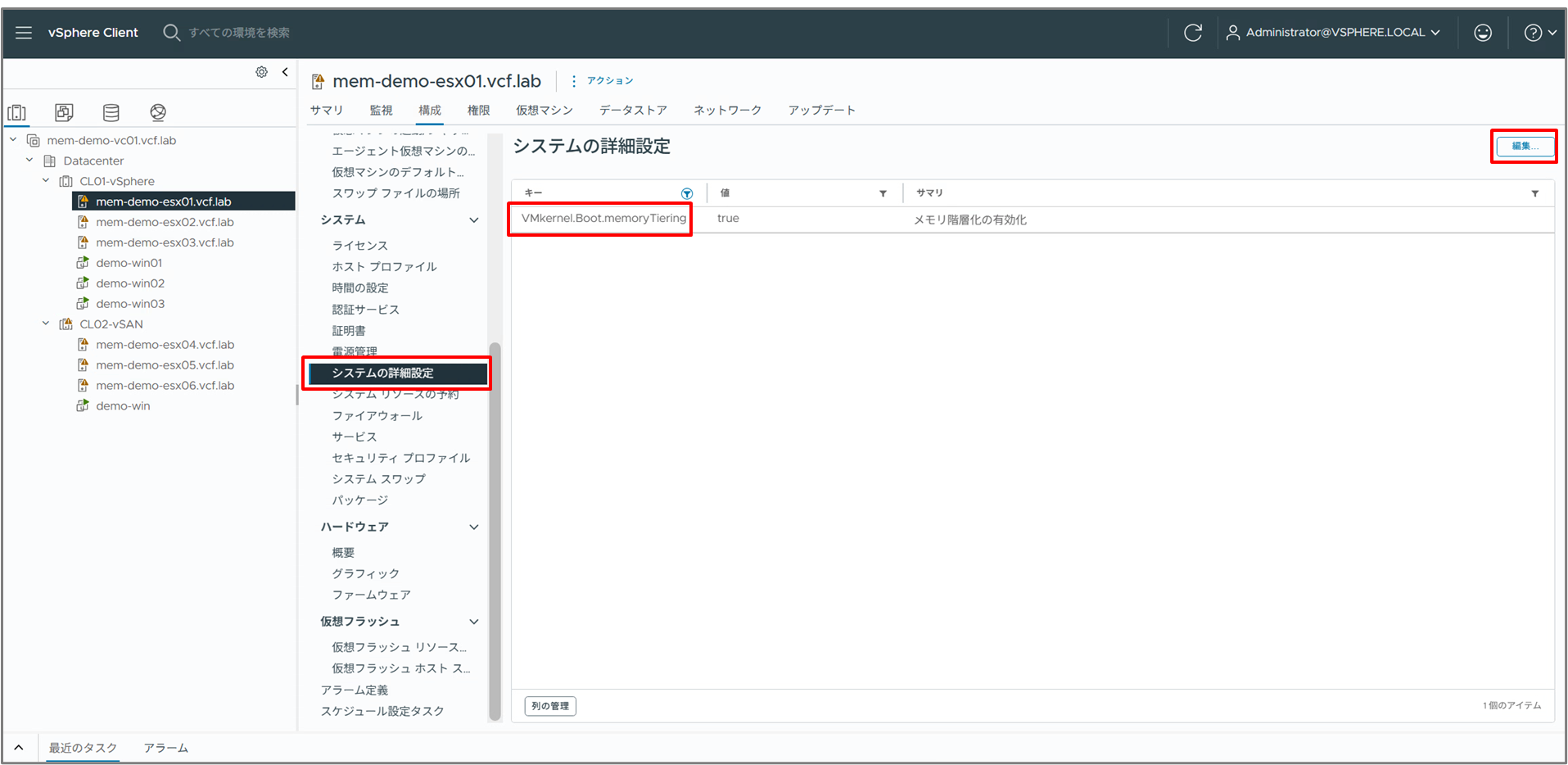

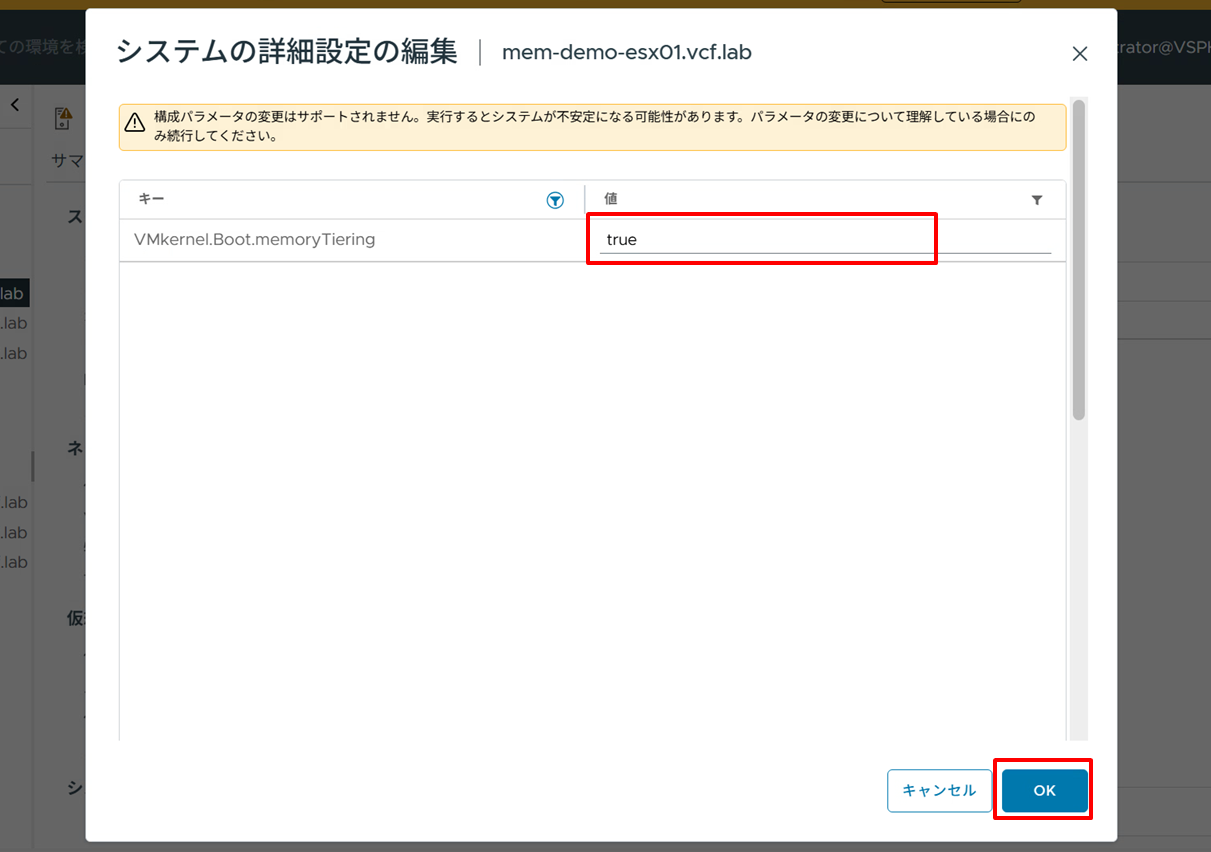

ESX ホストの構成から「システムの詳細設定」を選択し、「VMKernel.Boot.memoryTiering」を確認します。「編集」をクリックします。

「編集」をクリックし、値を「true」に変更して、「OK 」をクリックします。

ESX ホストを再起動します。対象ホスト分繰り返して作業して完了です。

参考②:vSAN クラスタ時の注意点

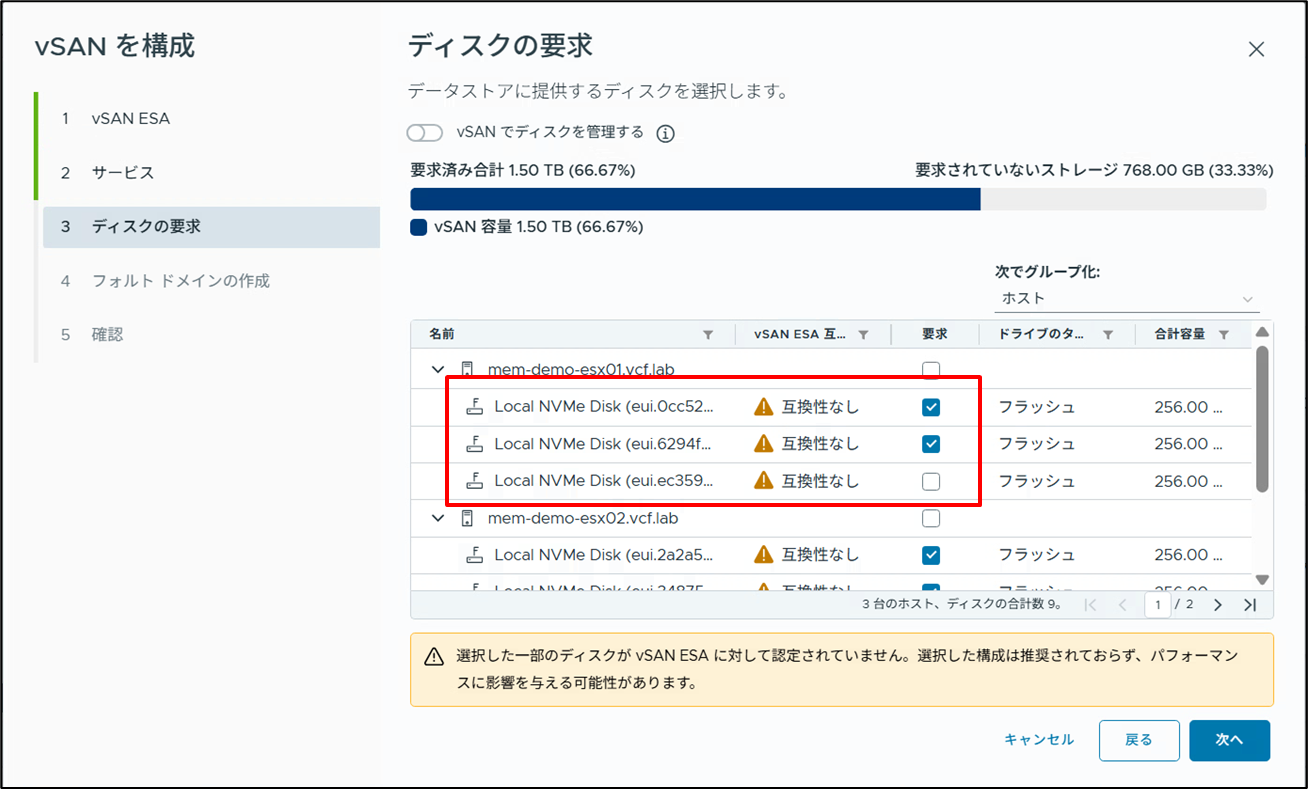

新規の vSAN クラスタ構築時

新規に vSAN クラスタを構築する際は、Memory Tiering 用のストレージデバイスを組み込まないようにします。

vSAN 構成ウィザードを進めると、「ディスクの要求」を設定する画面が表示されます。ここですべてのストレージを選択せず、Memory Tiering として使用するデバイスにはチェックを入れないようにして設定を進めることで、そのデバイスをvSAN用ディスク候補から外すことができます。

既存 vSAN クラスタに Memory Tiering 用のストレージデバイスを追加する場合

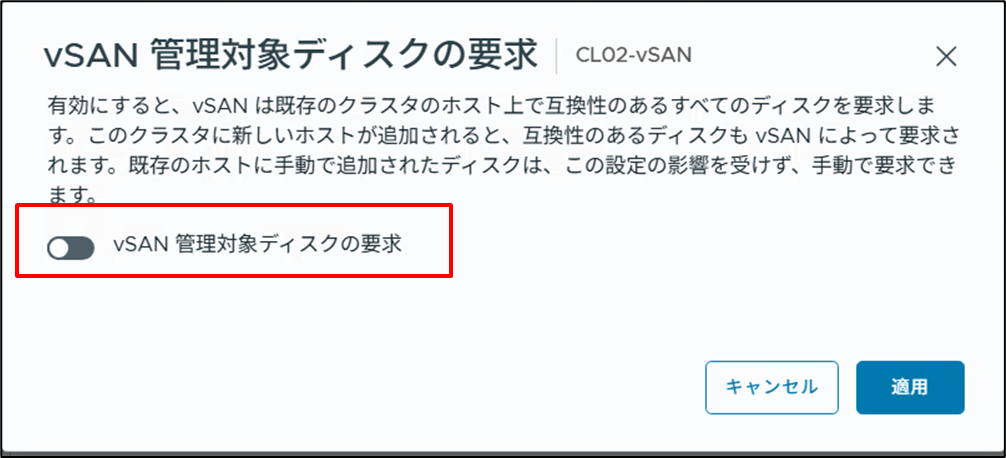

既存の vSAN クラスタがストレージデバイスを自動で要求する設定になっている場合、Memory Tiering 用のストレージデバイスを追加した際に自動的に vSAN ディスクとして認識されてしまいます。この設定がなされている場合には、設定をオフにする必要があります。

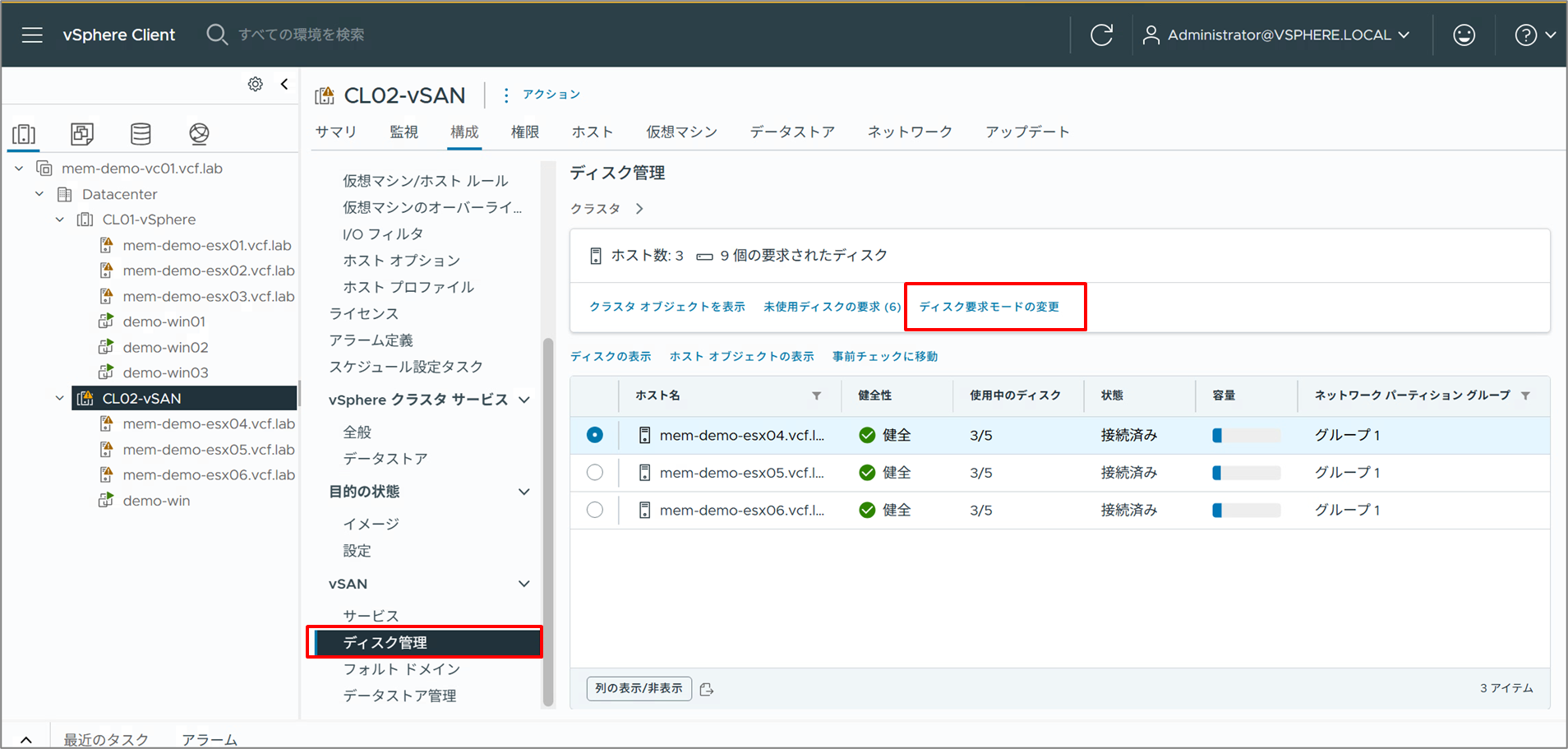

vSAN クラスタの構成から「ディスク管理」を選択し、「ディスク要求モードの変更」をクリックします。

「vSAN 管理対象ディスクの要求」がオンになっている場合は、オフにします。

これにより、運用中に Memory Tiering 用のストレージデバイスを追加しても vSAN 用のストレージデバイスとして認識されないようになります。

日常運用機能の検証

Memory Tiering を有効化した後、vSphere の各種運用機能に影響がないかを確認しました。

具体的には、仮想マシンのライブマイグレーションを行う vMotion、リソースの最適配置を自動で実施する DRS、ホスト障害時の自動復旧を担う HA など、日常運用において重要となる機能について検証を実施しました。

検証の結果、いずれの機能も期待どおりに動作し、Memory Tiering の有効化による影響や問題は確認されませんでした。これにより、Memory Tiering を適用した環境においても、従来どおりの運用が継続可能であることを確認できました。

今回は Nested 環境での検証であるため、パフォーマンス検証は実施していません。パフォーマンスに関する詳細については、メーカーの記事で紹介されていますので、以下をご確認ください。

Memory Tiering Performance in VMware Cloud Foundation 9.0:

https://blogs.vmware.com/cloud-foundation/2025/07/17/memory-tiering-performance-in-vmware-cloud-foundation-9-0/

さいごに

本記事では、vSphere 9 の新機能である Memory Tiering の有効化手順について紹介しました。設定自体はシンプルであり、vSphere Configuration Profiles を活用することでクラスタ全体に対して効率よく適用できる点も理解いただけたかと思います。

また、メジャーな vSphere 運用機能(vMotion / DRS / HA など)に影響を与えることなく利用できるため、導入ハードルも比較的低いといえます。特に、物理メモリ(DRAM)の増設が難しい場合やコストを抑えたい場合において、有効な選択肢となるかと思います。

一方で、Memory Tiering は DRAM と NVMe の特性差を前提とした仕組みであるため、ワークロードによってはパフォーマンスへの影響が出る可能性もあります。そのため、本番環境へ導入する際は、事前に十分な検証を行い、適切な設定値を検討することが重要だと感じました。

Memory Tiering は、今後の仮想化基盤におけるリソース活用の幅を広げる機能の一つです。本記事が、導入検討や検証の参考となれば幸いです。

著者紹介

SB C&S株式会社

ICT事業本部 技術本部 第1技術統括部

第1技術部 1課

山田 和良 - Kazuyoshi Yamada -

VMware vExpert